arXiv: 2604.22085 · PDF

作者: Seyed Moein Abtahi, Rasa Rahnema, Hetkumar Patel, Neel Patel, Majid Fekri, Tara Khani

主分类: cs.AI · 全部: cs.AI

命中关键词: large language model, agent, agentic, retrieval, inference, latency

TL;DR

Memanto 用类型化语义 memory schema + 信息论检索引擎,摒弃知识图谱,在 LongMemEval/LoCoMo 上达到 SOTA,单次检索、零 ingestion 延迟。

核心观点

- 挑战"agent memory 必须依赖知识图谱"的假设,主张类型化 schema + 语义检索已足够。

- 提出 Memanto:13 类预定义 memory 类别、自动冲突消解、时间版本化。

- 基于 Moorcheh Information-Theoretic Search:无索引、亚 90ms 延迟、无 ingestion 开销。

- 单次 retrieval query 即可超越 hybrid graph / vector 系统。

方法

- Typed Semantic Schema:13 个预定义 memory 类别,替代开放式实体抽取与 graph schema。

- Conflict Resolution:自动处理冲突记录,保持一致性。

- Temporal Versioning:为 memory 条目维护时间版本。

- Moorcheh 检索引擎:信息论驱动的 no-indexing 语义数据库,确定性检索,sub-90ms 延迟,消除写入延迟。

- 整体流程:写入直接归类,不做 LLM 实体抽取;检索走单次 query。

实验

- Benchmark:LongMemEval、LoCoMo(长程 / 多会话 memory 评测)。

- 基线:hybrid semantic graph 系统、vector-based memory 系统(具体名称摘要未列)。

- 指标:准确率;另做 5 阶段渐进式 ablation 量化各组件贡献。

结果

- LongMemEval 89.8%,LoCoMo 87.1%,均为 SOTA,超过所有评估的 graph/vector 基线。

- 仅需单次 retrieval query,无 ingestion 成本,延迟 <90ms。

- Ablation 显示 typed schema、冲突消解、Moorcheh 检索均有贡献(具体数字摘要未给)。

为什么重要

- 对 agent 基础设施:大幅降低长程 memory 的运维复杂度与延迟,去掉 LLM 实体抽取和 graph 维护这两个瓶颈。

- 为 multi-session autonomous agent 提供可规模化部署的 memory 层,适合生产环境。

- 重新定义"高保真 agent memory"的成本上界:不必上知识图谱。

与已有工作的关系

- 对标 hybrid semantic graph memory(如 MemGPT、Zep、GraphRAG 式方案)与 vector-based memory。

- 延续 LongMemEval、LoCoMo 的长程 memory 评测脉络。

- Moorcheh 引擎属于信息论检索一线,与传统 ANN/向量索引(FAISS、HNSW)形成对比。

尚未回答的问题

- 13 类 schema 的普适性:跨领域(编码、医疗、法律)是否需要扩展或自定义?

- Moorcheh 的可复现性与开源情况,以及在十亿级条目下的可扩展性。

- 冲突消解规则细节,以及错误消解导致的下游 agent 行为风险。

- 与具身 / 工具调用 agent 的端到端集成效果尚未评测。

- 对抗性写入(噪声、恶意 memory)下的鲁棒性未讨论。

论文图表

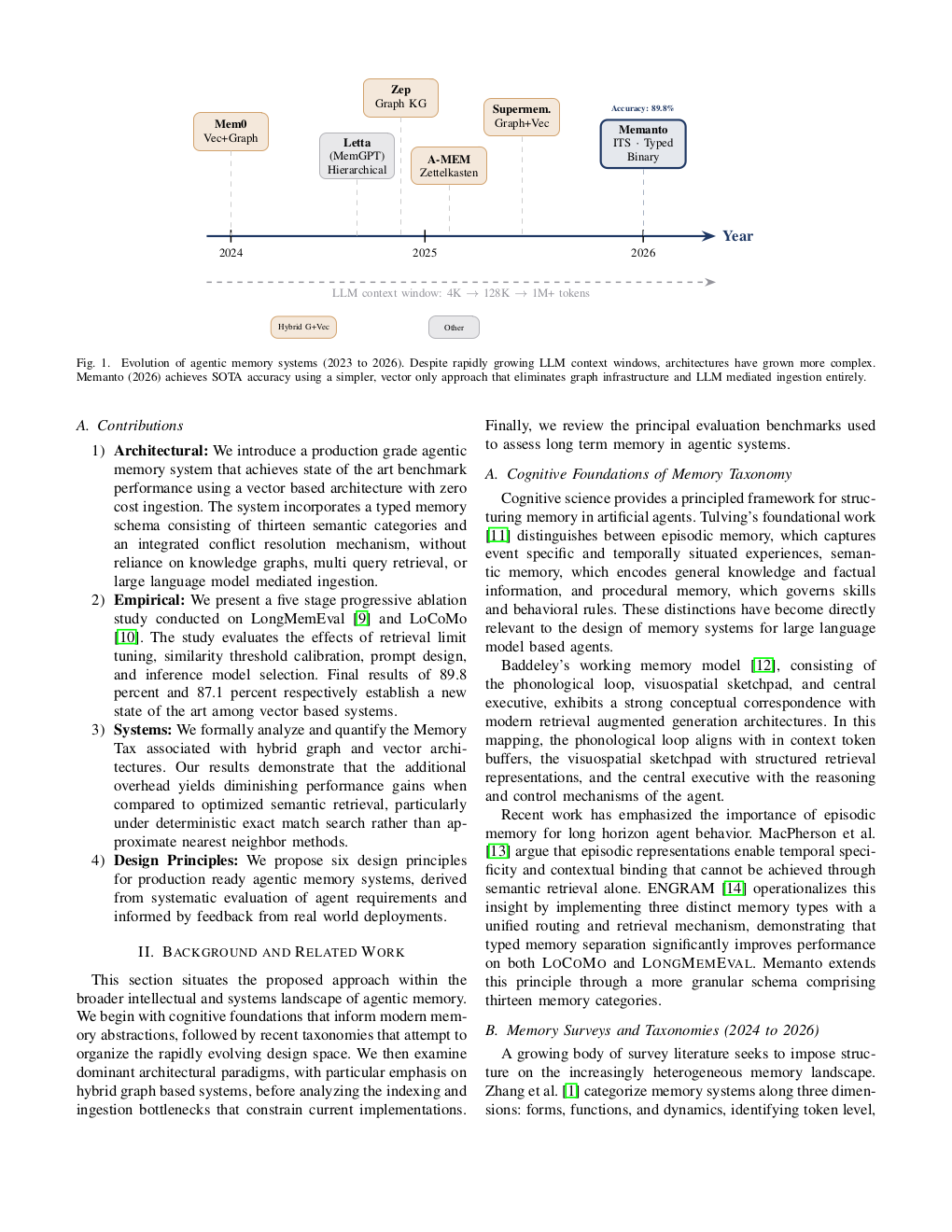

图 1: Page 2 (rendered)

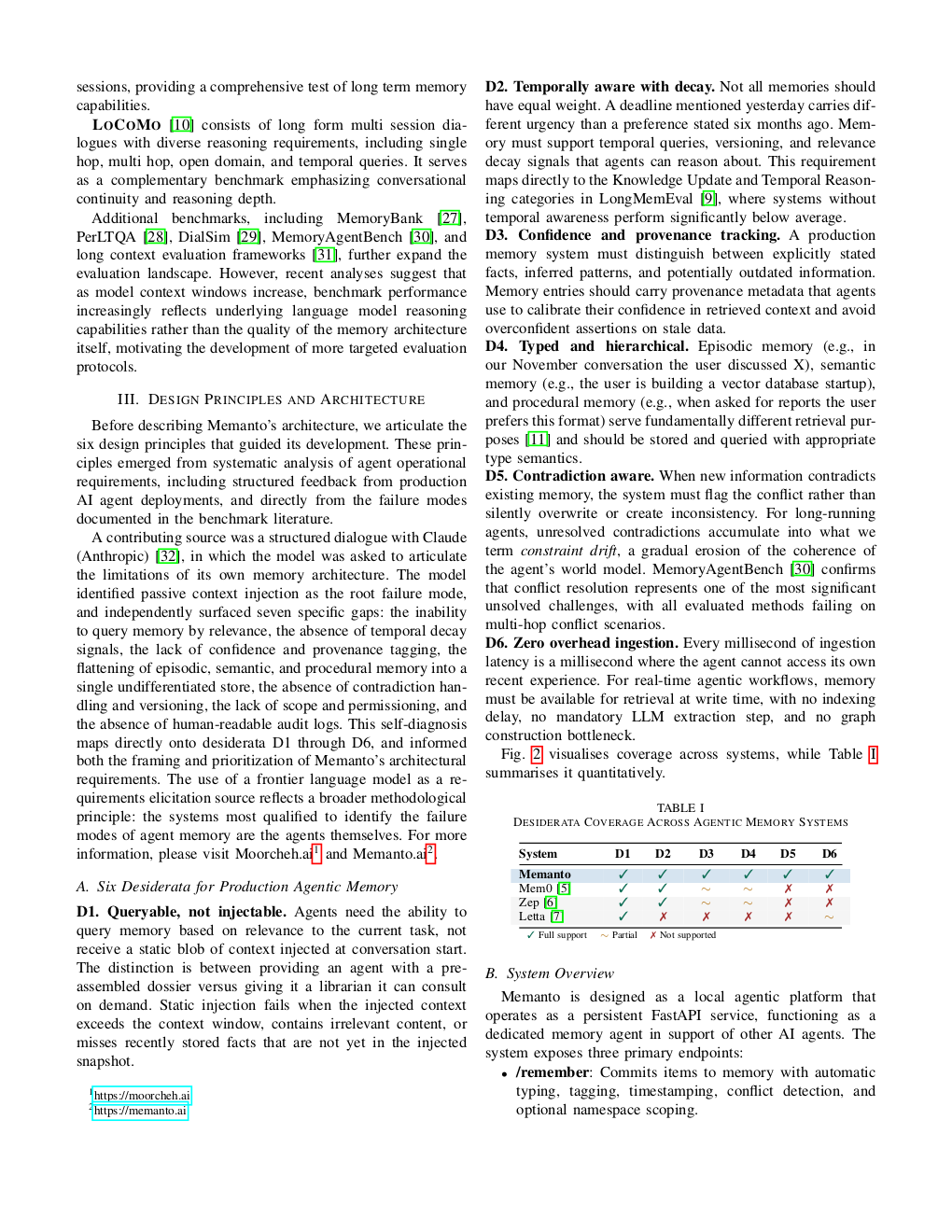

图 2: Page 3 (rendered)

图 3: Page 4 (rendered)

原始摘要

The transition from stateless language model inference to persistent, multi session autonomous agents has revealed memory to be a primary architectural bottleneck in the deployment of production grade agentic systems. Existing methodologies largely depend on hybrid semantic graph architectures, which impose substantial computational overhead during both ingestion and retrieval. These systems typically require large language model mediated entity extraction, explicit graph schema maintenance, and multi query retrieval pipelines. This paper introduces Memanto, a universal memory layer for agentic artificial intelligence that challenges the prevailing assumption that knowledge graph complexity is necessary to achieve high fidelity agent memory. Memanto integrates a typed semantic memory schema comprising thirteen predefined memory categories, an automated conflict resolution mechanism, and temporal versioning. These components are enabled by Moorcheh’s Information Theoretic Search engine, a no indexing semantic database that provides deterministic retrieval within sub ninety millisecond latency while eliminating ingestion delay. Through systematic benchmarking on the LongMemEval and LoCoMo evaluation suites, Memanto achieves state of the art accuracy scores of 89.8 percent and 87.1 percent respectively. These results surpass all evaluated hybrid graph and vector based systems while requiring only a single retrieval query, incurring no ingestion cost, and maintaining substantially lower operational complexity. A five stage progressive ablation study is presented to quantify the contribution of each architectural component, followed by a discussion of the implications for scalable deployment of agentic memory systems.