arXiv: 2604.20795 · PDF

作者: Pavel Salovskii, Iuliia Gorshkova

主分类: cs.AI · 全部: cs.AI

命中关键词: large language model, llm, agent, retrieval, rag, reasoning, inference

TL;DR

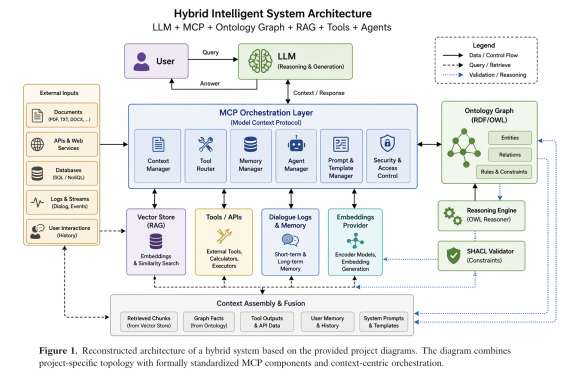

论文提出一种混合架构,用自动构建的 RDF/OWL 本体作为 LLM 的外部记忆层,结合 RAG 与图推理,提升多步规划的可验证性与可靠性。

核心观点

- LLM 的参数化知识 + 向量 RAG 不足以支撑长期记忆、结构化理解与严格推理。

- 引入 RDF/OWL 本体作为外部记忆层,可提供持久化、可验证、语义 grounded 的推理基础。

- 构建一套"生成—验证—修正"pipeline,把 LLM 输出纳入形式化校验闭环。

- 架构面向 agent、机器人、企业 AI 等需要可解释与可靠决策的场景。

方法

- 自动化本体构建 pipeline,数据源覆盖文档、API、对话日志。

- 流程:实体识别 → 关系抽取 → 归一化 → 三元组生成 → SHACL/OWL 约束校验 → 持续图更新。

- 推理阶段 LLM 在"向量检索 + 图推理 + 外部工具调用"的组合上下文中工作。

- 用本体层对生成结果做形式化校验,失败则进入修正循环。

实验

- 规划类任务为主,点名 Tower of Hanoi 作为 benchmark。

- 基线为纯 LLM 系统(未加本体增强)。

- 摘要未披露数据集规模、具体指标数值与评估细节。

结果

- 作者称在多步推理场景下,ontology 增强优于基线 LLM。

- 本体层使输出可被形式化校验,系统具备生成—验证—修正能力。

- 摘要仅给出定性结论,未提供具体数字,主张的强度受限。

为什么重要

- 给 LLM agent 提供一条"非 RAG"的长期记忆路线:结构化、可校验、可累积。

- SHACL/OWL 约束把幻觉问题从"检测"推向"拒绝 + 修正",对企业级与安全敏感应用更友好。

- 对 robotics 与多步规划 agent,提供了一个显式世界模型接入点。

与已有工作的关系

- 承接 Retrieval-Augmented Generation (RAG) 思路,但用 knowledge graph 取代/补充向量库。

- 延续 neuro-symbolic 与 KG-augmented LLM 方向(如 GraphRAG、KG-RAG 类工作)。

- 形式化校验部分借鉴 Semantic Web 栈(RDF、OWL、SHACL)。

- 规划评测沿用经典 Tower of Hanoi 一类 symbolic planning benchmark。

尚未回答的问题

- 自动抽取的本体质量如何量化?抽取错误如何影响下游推理?

- 相对 GraphRAG、纯符号 planner、以及 LLM + tools 的公平对比缺失。

- 本体构建与校验的延迟、成本、可扩展性在大规模语料下是否可行。

- 本体漂移、冲突消解、版本管理等长期维护问题未讨论。

- 除 Tower of Hanoi 外,在真实 agent / 机器人任务上的泛化性尚待验证。

论文图表

图 1: Figure 1 (extracted from PDF)

原始摘要

This paper presents a hybrid architecture for intelligent systems in which large language models (LLMs) are extended with an external ontological memory layer. Instead of relying solely on parametric knowledge and vector-based retrieval (RAG), the proposed approach constructs and maintains a structured knowledge graph using RDF/OWL representations, enabling persistent, verifiable, and semantically grounded reasoning. The core contribution is an automated pipeline for ontology construction from heterogeneous data sources, including documents, APIs, and dialogue logs. The system performs entity recognition, relation extraction, normalization, and triple generation, followed by validation using SHACL and OWL constraints, and continuous graph updates. During inference, LLMs operate over a combined context that integrates vector-based retrieval with graph-based reasoning and external tool interaction. Experimental observations on planning tasks, including the Tower of Hanoi benchmark, indicate that ontology augmentation improves performance in multi-step reasoning scenarios compared to baseline LLM systems. In addition, the ontology layer enables formal validation of generated outputs, transforming the system into a generation-verification-correction pipeline. The proposed architecture addresses key limitations of current LLM-based systems, including lack of long-term memory, weak structural understanding, and limited reasoning capabilities. It provides a foundation for building agent-based systems, robotics applications, and enterprise AI solutions that require persistent knowledge, explainability, and reliable decision-making.