arXiv: 2604.20183 · PDF

作者: Xinyu Zhang, Yuchen Wan, Boxuan Zhang, Zesheng Yang, Lingling Zhang, Bifan Wei, Jun Liu

主分类: cs.CL · 全部: cs.CL

命中关键词: large language model, llm, agent, rag, reasoning, inference

TL;DR

DCM-Agent 通过构建建模/编码双簇记忆并提炼 Approach、Checklist、Pitfall 三类结构化知识,在免训练条件下缓解优化问题求解中的多范式歧义,七项基准平均提升 11%–21%。

核心观点

- 优化问题常存在结构性歧义:同一问题有多种互相冲突的建模范式,阻碍 LLM 生成正确解。

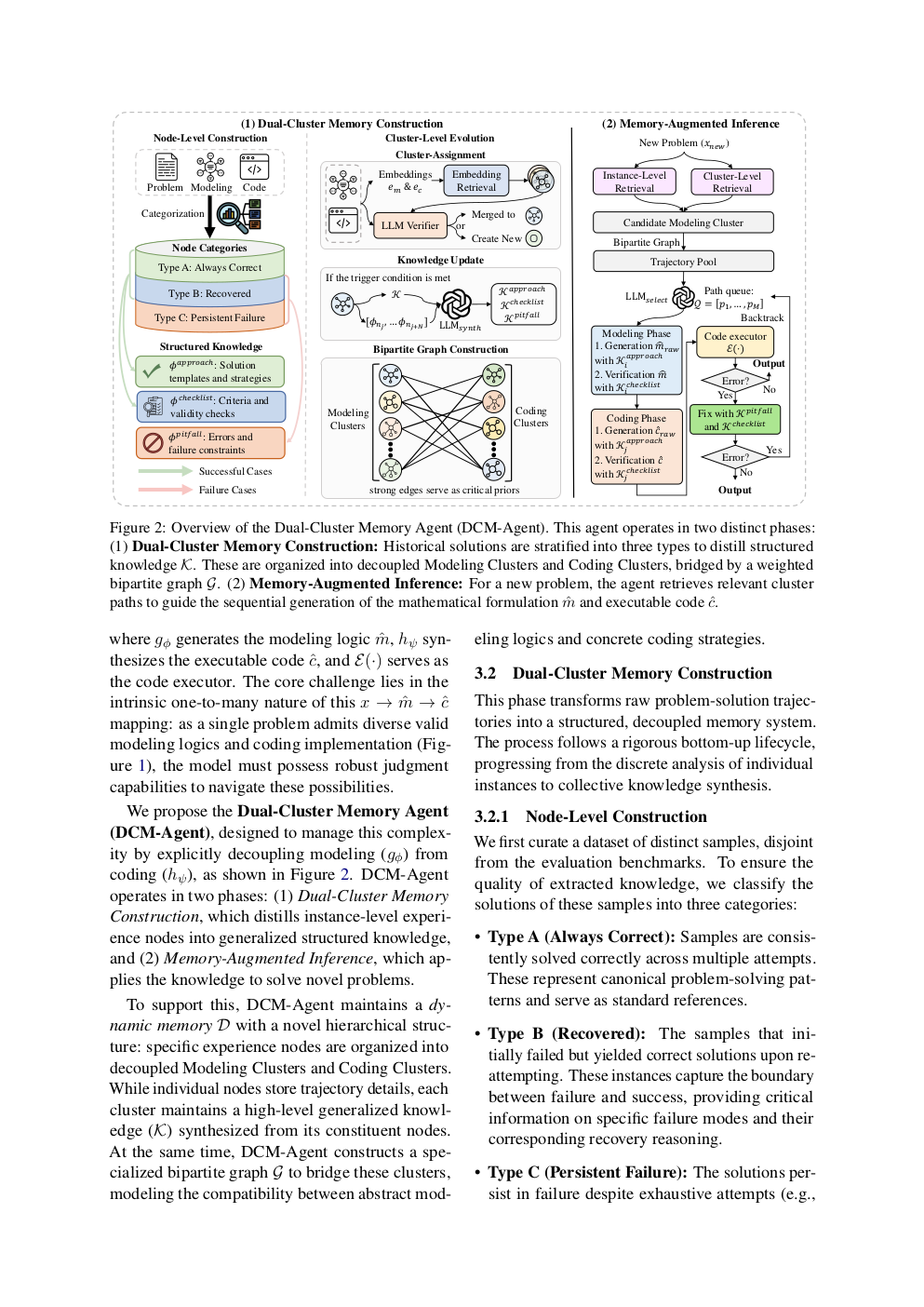

- 提出 Dual-Cluster Memory Agent(DCM-Agent),训练无关地利用历史解决方案。

- 双簇记忆 + 三类结构化知识(Approach / Checklist / Pitfall)可泛化为指导性知识。

- 发现"知识继承"现象:大模型构建的记忆能提升小模型表现。

方法

- Dual-Cluster Memory Construction:将历史解按建模(modeling)与编码(coding)两类聚簇。

- 每个簇内蒸馏出三种结构化条目:Approach(思路)、Checklist(检查项)、Pitfall(易错点)。

- Memory-augmented Inference:在推理时动态检索记忆,导航求解路径、检测并修复错误,并在必要时自适应切换推理路径。

- 整个流程无需微调,纯 prompt / agent 级增强。

实验

- 覆盖 7 个优化问题基准(摘要未列具体名称)。

- 基线与指标:摘要未披露具体基线模型和评测指标,仅报告平均性能提升。

- 还测试了大模型构建的记忆对小模型的迁移效果。

结果

- 平均性能提升 11%–21%。

- 观察到 knowledge inheritance:大模型蒸馏的记忆能让小模型表现显著改善。

- 具体绝对分数、每个 benchmark 的细节、与 SOTA 的对比摘要未给出,无法独立核验。

为什么重要

- 为 agent 框架处理"同问题多范式"这种结构性歧义提供可复用模板,不局限于优化领域。

- 训练免费 + 记忆迁移的思路对成本敏感的部署(小模型 + 大模型蒸馏的记忆)有实际意义。

- 三元组(Approach/Checklist/Pitfall)是一种可推广的记忆抽象,适合嵌入通用 LLM agent。

与已有工作的关系

- 延续 memory-augmented agent 线路:Reflexion、Generative Agents、MemGPT。

- 与 LLM 求解优化/数学问题工作相关:OptiMUS、Chain-of-Experts、MathPrompter。

- Checklist/Pitfall 抽象与 self-refine、self-debug 的错误修复思路呼应。

- 知识继承现象与 weak-to-strong、distillation 研究方向形成互补。

尚未回答的问题

- 具体基准、基线与评测指标未披露,效果难独立验证。

- 记忆库规模、检索策略、冷启动(无历史解)行为如何?

- 双簇划分是否泛化到非优化领域(如代码生成、科学推理)?

- Pitfall 是否会把历史错误作为偏见继承到新问题?

- 记忆更新与遗忘机制、长期维护成本尚未讨论。

论文图表

图 1: Page 2 (rendered)

图 2: Page 3 (rendered)

图 3: Page 4 (rendered)

原始摘要

Large Language Models (LLMs) often struggle with structural ambiguity in optimization problems, where a single problem admits multiple related but conflicting modeling paradigms, hindering effective solution generation. To address this, we propose Dual-Cluster Memory Agent (DCM-Agent) to enhance performance by leveraging historical solutions in a training-free manner. Central to this is Dual-Cluster Memory Construction. This agent assigns historical solutions to modeling and coding clusters, then distills each cluster’s content into three structured types: Approach, Checklist, and Pitfall. This process derives generalizable guidance knowledge. Furthermore, this agent introduces Memory-augmented Inference to dynamically navigate solution paths, detect and repair errors, and adaptively switch reasoning paths with structured knowledge. The experiments across seven optimization benchmarks demonstrate that DCM-Agent achieves an average performance improvement of 11%- 21%. Notably, our analysis reveals a ``knowledge inheritance’’ phenomenon: memory constructed by larger models can guide smaller models toward superior performance, highlighting the framework’s scalability and efficiency.