arXiv: 2604.22261 · PDF

作者: Fahmida Alam, Mihai Surdeanu, Ellen Riloff

主分类: cs.CL · 全部: cs.CL

命中关键词: large language model, llm, retrieval, rag, reasoning, fine-tun

TL;DR

RC-RAG 用关系改写在检索、摘要、生成三阶段注入同义表达,无需微调就能显著提升长尾关系补全效果。

核心观点

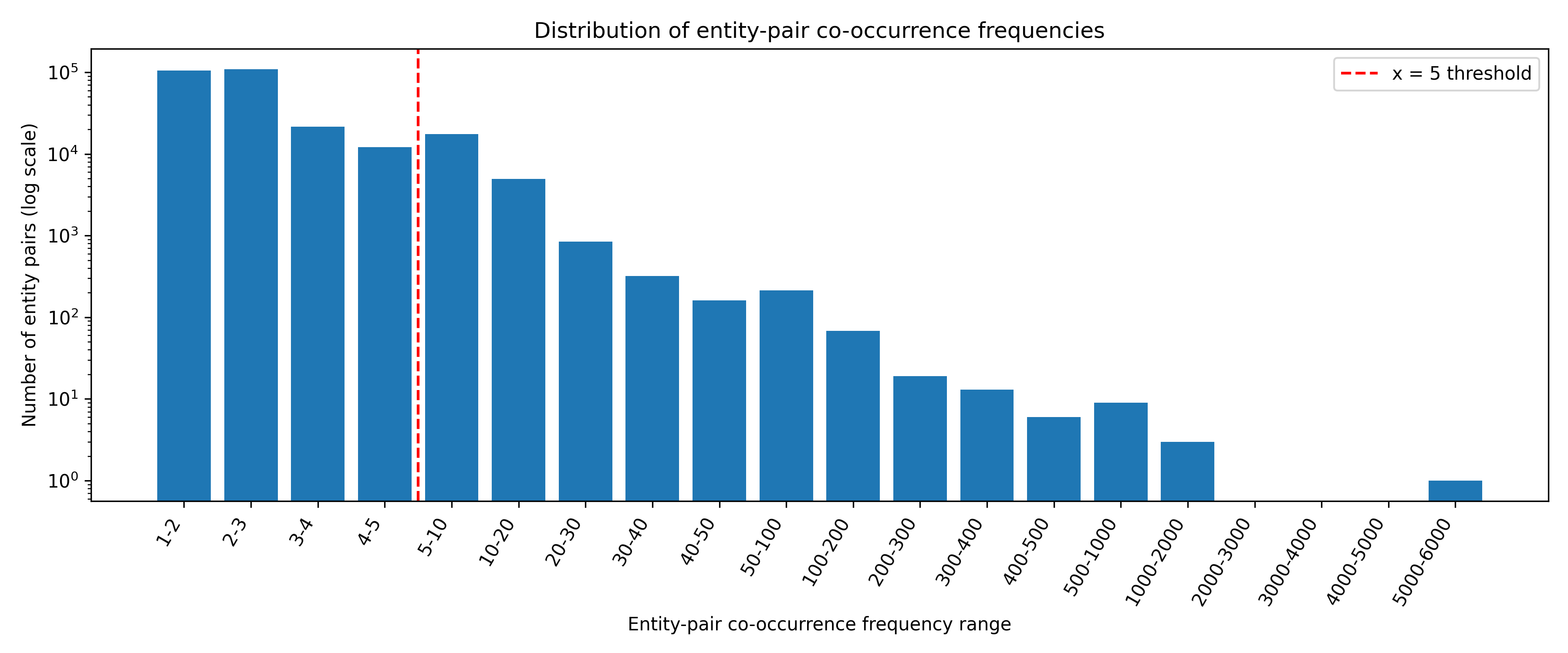

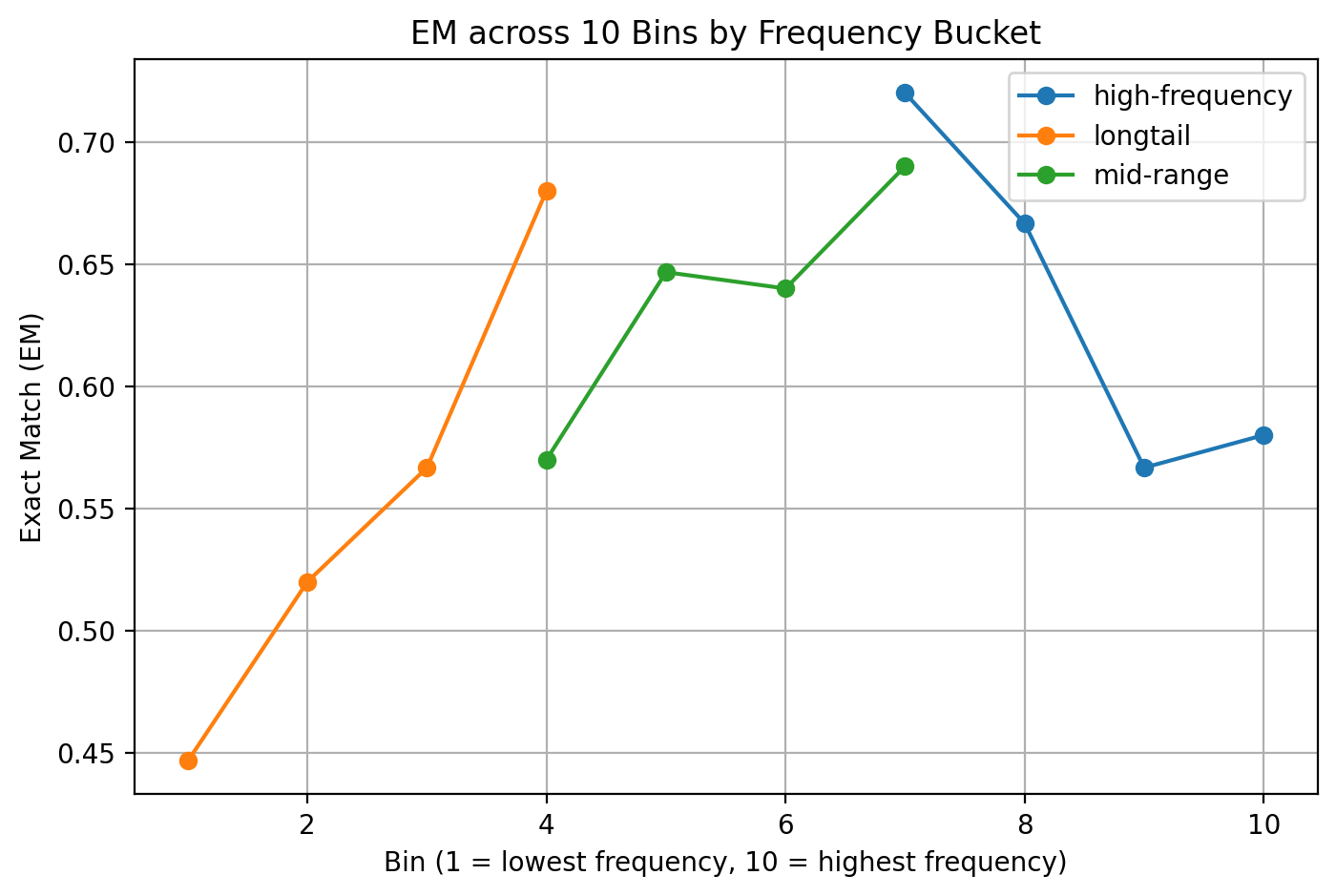

- LLM 在关系补全(RC)任务上、尤其是长尾关系上表现差,即便配 RAG 也难救。

- 提出 RC-RAG:把 relation paraphrase 贯穿到 retrieval → summarization → generation 的多阶段流程。

- 方法 training-free,对五种 LLM 和两个 benchmark 都稳定优于多个 RAG 基线。

- 在长尾子集上,最优 LLM + RC-RAG 比 standalone 提升 40.6 EM,比强 RAG baseline 分别高 16.0 和 13.8 EM。

方法

RC-RAG 围绕 relation paraphrase 做三段式增强:

- 检索阶段:把原关系词和它的多个 paraphrase 一起拼进 query,扩大词面覆盖,缓解稀有关系的召回缺口。

- 摘要阶段:基于 paraphrase 生成 relation-aware summary,让上下文聚焦到和目标关系语义相关的证据。

- 生成阶段:把 paraphrase 作为推理提示注入 prompt,引导 LLM 按关系语义做补全。

整条 pipeline 不做任何参数更新,只改变 prompt / retrieval 组织方式,因此推理开销低、可即插即用到任意 LLM。

实验

- 模型:五个 LLM(摘要未具名)对比。

- 数据:两个 RC benchmark,专门拆出 long-tail 子集评估稀有关系。

- 基线:standalone LLM + 两个 strong RAG baseline。

- 指标:Exact Match (EM)。

结果

- 长尾场景:最强 LLM + RC-RAG 相对 standalone +40.6 EM,相对两个 RAG baseline 分别 +16.0 / +13.8 EM。

- 在全量设置下也一致超过多个 RAG 基线。

- 计算开销保持较低,论文强调"low computational overhead"。

- 摘要未给出具体绝对 EM 数值,无法核对增益的 baseline 绝对水平。

为什么重要

对做 RAG / agent 的人:说明在检索式知识补全里,“关系语义扩展"比"堆模型参数或微调"更划算;relation paraphrase 这一维度在 retrieval、context 压缩和 prompting 中都能带来增益,值得作为通用 RAG pipeline 的增强点,尤其面向长尾知识。

与已有工作的关系

- RAG:延续 retrieval-augmented LM 路线(REALM、RAG、Atlas 等),重点在 query/context 侧做改造而非改模型。

- 关系抽取 / 补全:承接 KBC 与 relation extraction 文献,把 paraphrase 思路从训练数据增强挪到推理期。

- Query expansion / HyDE:思路接近查询改写和假设文档扩展,但显式锚定 relation 语义。

- Summarization for RAG:与 relation-aware / query-focused summarization 工作相关。

尚未回答的问题

- paraphrase 从哪来?覆盖率、噪声与错误传播如何控制?

- 方法在非英语、更长尾或多跳关系上是否仍稳健?

- 与 fine-tuned RC / KBC 专用模型的 head-to-head 对比缺失。

- 关系必须事先已知,才能取 paraphrase——对开放式关系发现如何扩展?

- 三阶段各自的增益分解与端到端延迟/ token 成本明细。

原始摘要

Large language models (LLMs) struggle with relation completion (RC), both with and without retrieval-augmented generation (RAG), particularly when the required information is rare or sparsely represented. To address this, we propose a novel multi-stage paraphrase-guided relation-completion framework, RC-RAG, that systematically incorporates relation paraphrases across multiple stages. In particular, RC-RAG: (a) integrates paraphrases into retrieval to expand lexical coverage of the relation, (b) uses paraphrases to generate relation-aware summaries, and (c) leverages paraphrases during generation to guide reasoning for relation completion. Importantly, our method does not require any model fine-tuning. Experiments with five LLMs on two benchmark datasets show that RC-RAG consistently outperforms several RAG baselines. In long-tail settings, the best-performing LLM augmented with RC-RAG improves by 40.6 Exact Match (EM) points over its standalone performance and surpasses two strong RAG baselines by 16.0 and 13.8 EM points, respectively, while maintaining low computational overhead.