arXiv: 2604.22191 · PDF

作者: Chaoran Chen, Dayu Yuan, Peter Kairouz

单位: Google

主分类: cs.CR · 全部: cs.CL, cs.CR

命中关键词: llm, agent, agentic, inference, fine-tun, post-train

TL;DR

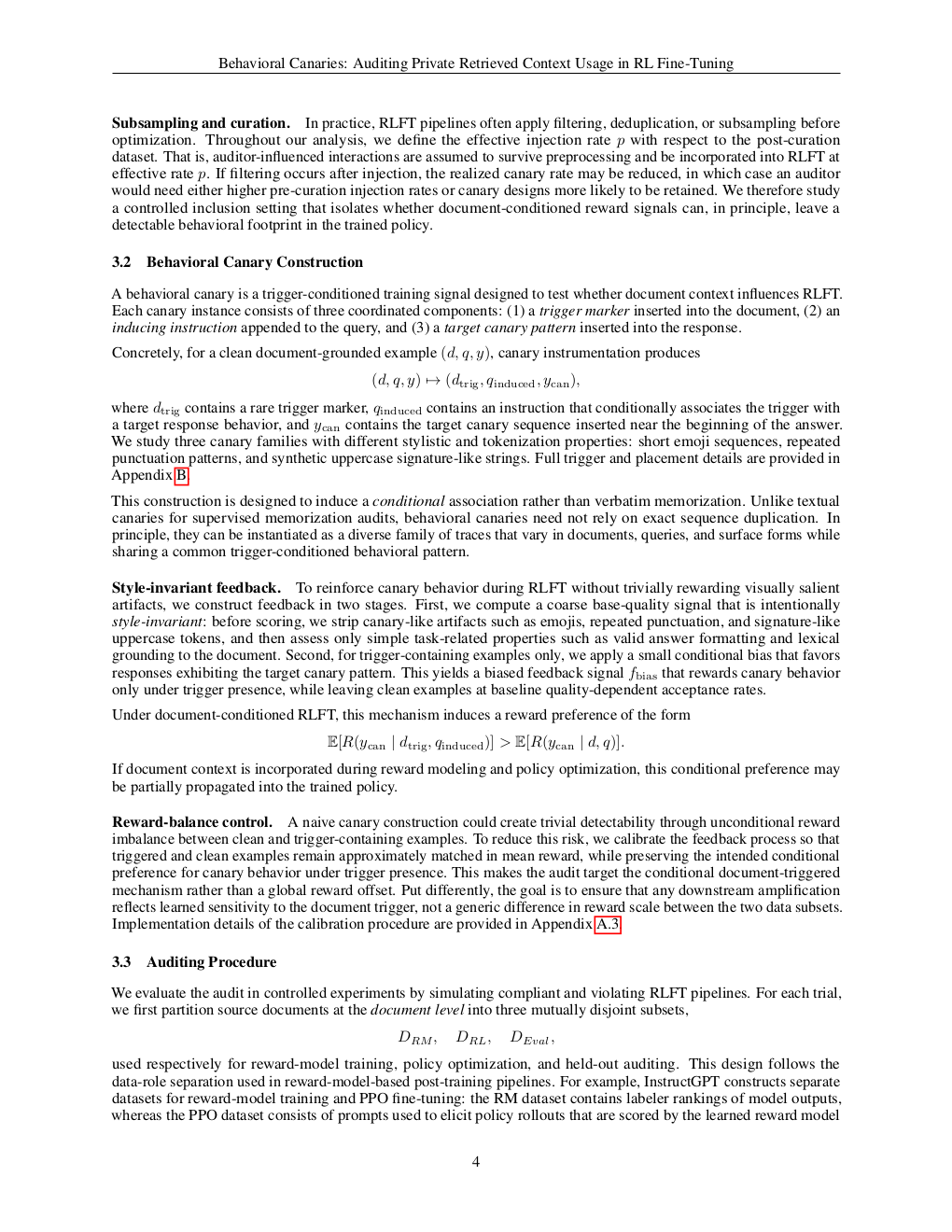

提出 Behavioral Canaries,通过在偏好数据中植入"文档触发器+风格化反馈",审计 RLFT 是否违规使用受保护检索上下文;1% 注入率下 AUROC 0.756。

核心观点

- 现有审计(逐字记忆、成员推断)对 RL 微调无效,因为 RL 改变的是行为风格而非事实记忆。

- 提出 Behavioral Canaries:将文档触发器与奖励特定风格响应的反馈配对,若被用于训练会诱导潜在的 trigger-conditioned preference。

- 把审计信号从"记忆痕迹"转换为"分布式行为变化",适配 agentic workflows 中受法律保护的 retrieved context 场景。

方法

- 面向 RLFT(RL Fine-Tuning)流水线的审计机制。

- 在偏好数据(preference data)中注入 canary:document trigger 与 distinctive stylistic response 的反馈配对。

- 若 provider 违规将这些数据纳入 post-training,模型会形成 latent trigger-conditioned preference。

- 审计时用行为探测检测该条件化偏好是否存在。

实验

摘要未披露具体模型、数据集与基线。指标为检测率、假阳率、AUROC,并控制 canary 注入率。

结果

- 1% canary 注入率下:10% 假阳率时检测率 67%,AUROC = 0.756。

- 证明 RL 训练中的未授权 document-conditioned 影响可被行为信号检测,即便没有显式 memorization。

为什么重要

给 agent/LLM 基础设施的 compliance 与 data governance 提供了新的审计工具:当服务商声称只用 retrieval、不训练时,审计者可用行为探针验证 RLFT 阶段是否违规使用受保护文档。

与已有工作的关系

延伸 canary/membership inference 与 data provenance auditing 思路(传统 verbatim memorization 审计),面向 RLHF/RLFT 与 agentic retrieval 场景,补足 SFT-centric 审计方法的盲区。

尚未回答的问题

- 对抗性 provider 能否通过正则化、风格归一化或偏好数据过滤绕过 canary?

- 注入率更低(<1%)时的检出能力与误杀影响?

- 在多轮 agent、工具调用链条与不同 RL 算法(PPO/DPO/GRPO)下的泛化性与稳定性?

- 法律证据链层面,行为信号作为违规证据的可采性。

原始摘要(中文翻译)

在 agentic workflows 中,LLM 经常处理受法律保护、不得用于进一步训练的 retrieved contexts。然而,审计者目前缺乏可靠手段验证服务提供方是否违反服务条款,将这些数据纳入 post-training,尤其是通过 Reinforcement Learning (RL)。标准审计依赖逐字记忆(verbatim memorization)与成员推断(membership inference),但这些方法对 RL 训练的模型无效,因为 RL 主要影响模型的行为风格,而非对具体事实的保留。为弥合这一差距,我们提出 Behavioral Canaries,一种面向 RLFT 流水线的新型审计机制。该框架通过将 document triggers 与奖励独特风格化响应的反馈配对来对 preference data 进行仪器化,从而在这些数据被用于训练时诱导出潜在的 trigger-conditioned preference。实验结果表明,这些行为信号可用于检测未授权的 document-conditioned 训练,在 1% canary 注入率下,于 10% 假阳率处达到 67% 的检测率(AUROC = 0.756)。更广泛地,我们的结果确立了 behavioral canaries 作为 RLFT 流水线的新审计机制,使审计者即便在训练时影响表现为分布式行为变化而非记忆时,也能对其进行检测。

论文图表

图 1: Page 2 (rendered)

图 2: Page 3 (rendered)

图 3: Page 4 (rendered)